在數字化時代,數據已成為企業最寶貴的資產之一。構建一個高效、可擴展且穩健的數據處理系統,離不開精心設計的大數據架構圖。這不僅是一個技術藍圖,更是連接數據源頭與業務價值的關鍵橋梁。本文旨在探討大數據架構圖設計的核心要素,以及如何構建一個高效的數據處理服務。

一、 大數據架構圖的核心構成

一個典型的大數據架構圖通常遵循分層設計理念,以實現邏輯清晰、職責分離和靈活擴展。其核心層次通常包括:

- 數據采集與接入層: 這是數據管道的起點。負責從各種異構數據源(如業務數據庫、應用程序日志、物聯網設備、第三方API等)實時或批量地采集數據。常見的工具有Apache Kafka(用于實時流)、Apache Flume、Sqoop以及云服務商提供的各種數據遷移工具。

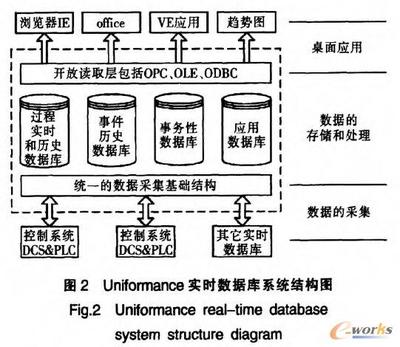

- 數據存儲層: 根據數據的熱度、訪問模式和結構,選擇合適的存儲方案。這通常是一個混合存儲體系:

- 批處理數據湖: 使用如Hadoop HDFS或云對象存儲(如AWS S3,阿里云OSS)來低成本、高可靠地存儲原始數據,支持任意格式,為后續探索性分析奠定基礎。

- 實時/交互式數據庫: 如Apache HBase、Cassandra,用于低延遲的隨機讀寫。

- 分析型數據倉庫: 如Apache Hive on Tez/Spark、云數據倉庫(如Snowflake,阿里云MaxCompute),用于對清洗后的數據進行復雜的SQL查詢和分析。

- 數據處理與計算層: 這是架構的“引擎”,負責將原始數據轉化為有價值的信息。它通常分為兩條并行的處理路徑:

- 批處理路徑: 處理海量歷史數據,計算周期長(如小時、天)。核心引擎是Apache Spark(因其內存計算和易用性已成為主流)或MapReduce。

- 流處理路徑: 處理無界數據流,實現亞秒級到秒級的低延遲分析。常用框架有Apache Flink(因其高吞吐、低延遲和精確一次語義而領先)、Apache Spark Streaming以及Kafka Streams。

- 數據服務與應用層: 將處理好的數據以服務的形式暴露給下游應用。這包括:

- OLAP分析服務: 通過Presto、Druid、ClickHouse等提供高速多維分析。

- 數據API服務: 通過RESTful API或GraphQL將數據提供給業務系統、數據產品(如推薦系統、風控模型)和可視化報表。

- 數據治理與安全層(貫穿始終): 這不是一個獨立的物理層,而是橫跨所有層次的關鍵能力。它包括元數據管理(如Apache Atlas)、數據血緣追蹤、數據質量管理、統一的安全認證與權限控制(如Apache Ranger),確保數據的可靠性、可信度與合規性。

二、 構建高效數據處理服務的關鍵原則

在設計架構圖時,應遵循以下原則以確保數據處理服務的高效性:

- Lambda與Kappa架構的抉擇與融合: 經典的Lambda架構同時維護批處理和流處理兩套邏輯,保證容錯但存在代碼重復。Kappa架構主張用一套流處理系統處理所有數據,簡化了架構。在實踐中,可根據業務場景融合兩者,例如用流處理處理實時需求,同時定期用批處理進行數據重算和糾偏。

- 解耦與彈性擴展: 各層次之間通過消息隊列(如Kafka)或對象存儲解耦,允許各組件獨立擴展,提高系統整體的彈性和容錯能力。利用云原生的彈性伸縮能力可進一步優化成本與性能。

- “可觀察性”設計: 從架構設計之初就集成全面的監控(Metrics)、日志(Logging)和追蹤(Tracing),實時掌握數據管道的健康狀態、處理延遲和數據質量,便于快速定位和解決問題。

- 自動化與DevOps: 將數據管道即代碼(Pipeline as Code),利用CI/CD工具實現數據處理作業的自動化測試、部署和運維,提升開發運維效率與系統可靠性。

三、 架構圖設計實踐:一個簡化的示例流程

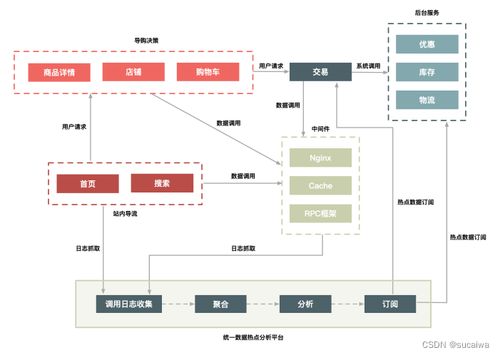

以一個電商用戶行為分析場景為例,其簡化的大數據架構流程可描述為:

- 用戶在前端的點擊、瀏覽、購買等日志,通過SDK實時發送到Apache Kafka(數據接入層)。

- 一個Apache Flink實時作業(流處理層)消費Kafka中的數據,進行實時過濾、聚合(如實時熱門商品),并將結果寫入Apache Druid(數據服務層)用于實時大盤展示,同時將原始數據備份到云對象存儲S3(數據湖存儲層)。

- 每日凌晨,一個Apache Spark批處理作業(批處理層)從S3中讀取全天數據,進行更復雜的清洗、關聯(如連接用戶屬性表)和聚合,生成結構化的業務寬表,并寫入云數據倉庫(如Snowflake,分析存儲層)。

- 業務分析師通過BI工具(如Tableau,應用層)連接數據倉庫和Druid,進行自助分析與報表制作。推薦系統通過數據API(數據服務層)調用處理后的用戶畫像和商品特征數據。

- 統一元數據與權限管理系統(治理層)監控整個流程的數據血緣,并管理各層數據的訪問權限。

###

一張優秀的大數據架構圖,是技術選型、流程設計與業務目標緊密結合的產物。它沒有一成不變的標準答案,但核心在于平衡實時性與準確性、靈活性與成本、開發效率與系統穩定性。隨著云原生、湖倉一體(Lakehouse)和流批一體(如Flink)等技術的發展,現代大數據架構正朝著更簡化、更統一、更智能的方向演進。設計者需要持續關注技術趨勢,并始終以解決實際業務問題、高效釋放數據價值為最終目標來繪制和迭代這張至關重要的技術藍圖。